突破大规模网络环境下感知认知的跨媒体、复杂语义、人机混合等问题,旨在形成网络环境下的超人感知、类人认知能力,具体研究内容包括:

1)跨媒体大尺度感知,面向图像、语音、文本等非结构化数据在内的跨媒体信息的大规模融合与识别,形成城市大脑和智能无人系统等应用的新引擎;

2)深度语义认知与交互,突破感知层面的“富语音分析”和认知层面的“认知型交互控制”关键技术,推动真实场景的语音识别、合成、理解、知识图谱等方向的应用,构建新一代智能语音交互支撑技术体系;

3)形成一个感、知、用一体化的研究平台,包括北斗+5G融合感知网、无源物联网、RGBD视频监控网,发展以人机混合增强、无人系统、自动驾驶为代表的智能感知认知创新应用。

群体行为建模

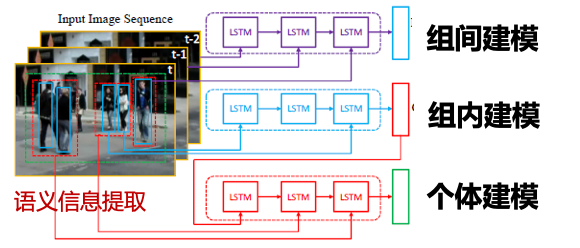

- 跨尺度人群建模

减少系统标定的复杂度

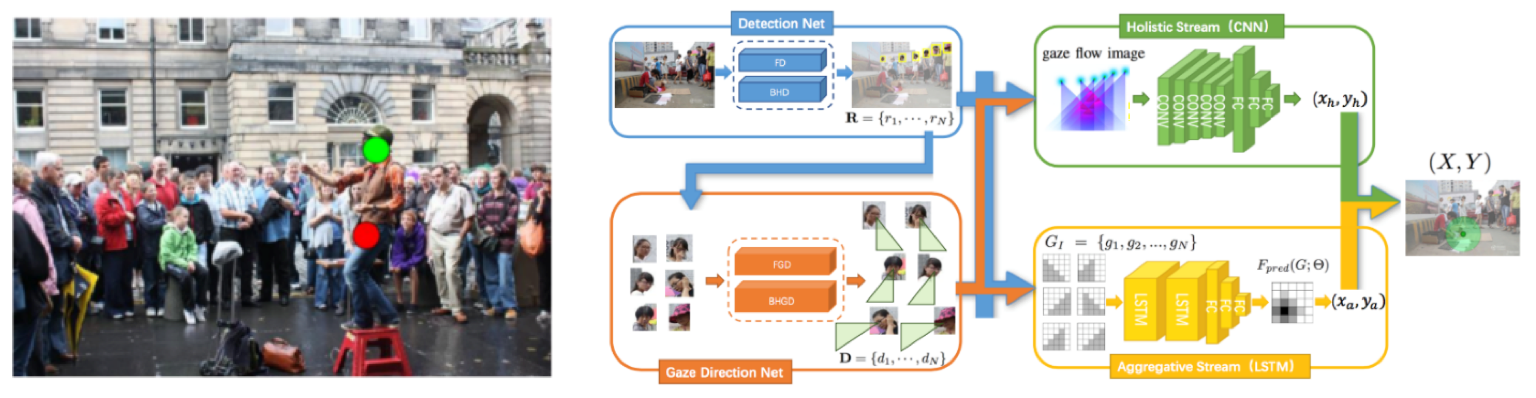

- 群体共同关注点建模

首次提出此类计算机视觉问题

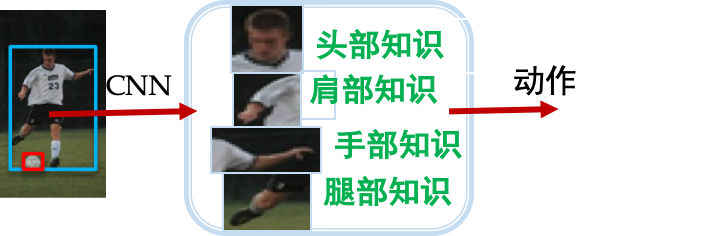

人类行为知识引擎

- 对称空间变换网络(SSTN):解决传统方法中的人体定位存在偏差问题

- 行为知识引擎(HAKE):10mAP 提高千万级别人体部件知识量

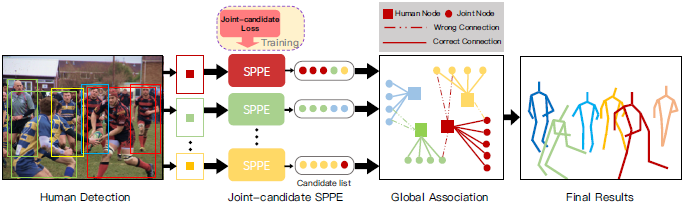

- 实时全局竞争匹配算法:面向解决密集人群姿态估计问题,准确率相对Mask RCNN(2017年ICCV最佳论文,马尔奖)提高了3%